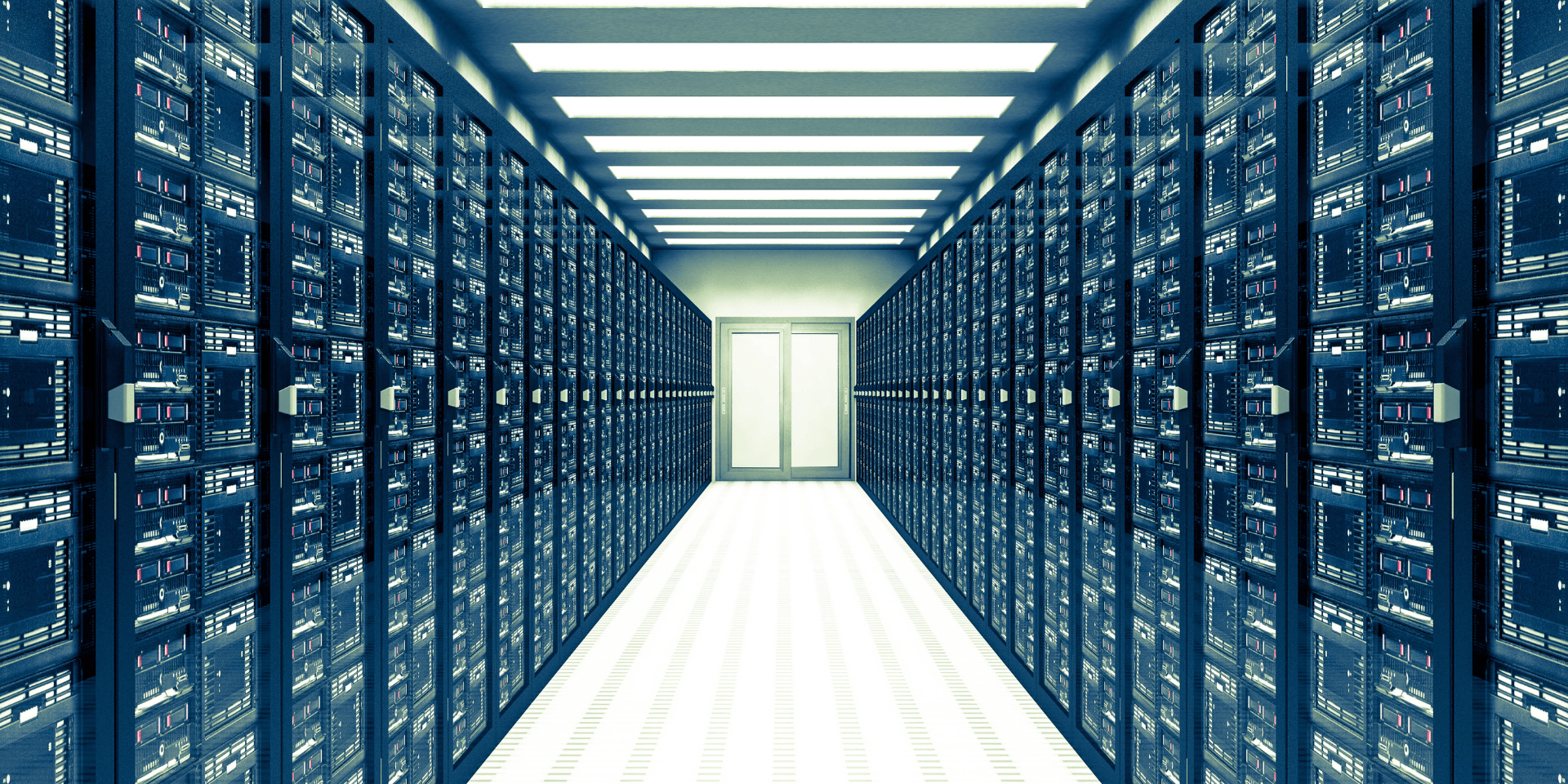

Los data centers son los edificios que sostienen Internet. Cada búsqueda en Google, cada serie en streaming, cada correo electrónico pasa por estas instalaciones repletas de servidores que procesan y almacenan información las 24 horas del día. Aunque parecen naves industriales anónimas, su diseño arquitectónico es extraordinariamente complejo. Un data center debe gestionar refrigeración extrema, garantizar seguridad física ante cualquier amenaza, asegurar redundancia total de sistemas y optimizar el consumo energético hasta el último vatio.

La arquitectura aquí es ingeniería de precisión.

La escala del fenómeno es enorme. Los data centers representaron aproximadamente el 1,5% del consumo eléctrico mundial en 2024, equivalente a 415 teravatios-hora (TWh), según la Agencia Internacional de Energía (AIE). Algunos de estos edificios ocupan superficies equivalentes a varios campos de fútbol y alojan decenas de miles de servidores.

El desafío térmico: refrigeración como prioridad arquitectónica

La refrigeración es el principal reto arquitectónico de un data center. Los servidores generan calor constantemente y necesitan mantenerse entre 18°C y 27°C para funcionar correctamente. El 40% de la energía que consume un data center se destina a refrigeración. La solución tradicional es el sistema de pasillos fríos y calientes: se alternan filas de servidores de forma que el aire frío entra por delante y el aire caliente sale por detrás, creando circuitos de ventilación separados. Esto evita que el aire caliente se mezcle con el frío y maximiza la eficiencia del sistema de climatización.

La seguridad física y la redundancia son los otros dos pilares del diseño. Un data center debe resistir incendios, inundaciones, cortes eléctricos y accesos no autorizados. La arquitectura incluye múltiples capas de seguridad: perímetros vallados, control de accesos biométrico, sistemas de detección de intrusiones y muros cortafuegos físicos. La redundancia significa duplicar o triplicar todos los sistemas críticos: generadores eléctricos de respaldo, sistemas de alimentación ininterrumpida (UPS), líneas de datos múltiples. Si un sistema falla, otro toma el relevo automáticamente. Esta redundancia se refleja en la distribución espacial del edificio, con salas técnicas separadas y rutas de cableado independientes.

Arquitectura que trasciende la función: ejemplos destacados

El data center de Facebook en Prineville (Oregón, 2011) fue pionero en transparencia y eficiencia. Fue el primer data center diseñado íntegramente por Facebook y marcó un cambio en la industria: la compañía publicó los planos arquitectónicos completos bajo licencia abierta a través del proyecto Open Compute. El edificio aprovecha el clima fresco de Oregón para reducir el uso de sistemas de refrigeración mecánica. En lugar de aire acondicionado tradicional, utiliza ventilación natural y evaporación de agua para enfriar los servidores. El diseño modular permite expandir la capacidad añadiendo nuevos módulos sin interrumpir las operaciones existentes.

Otro ejemplo destacado es el data center de Google en Hamina (Finlandia, 2011), que ocupa una antigua fábrica de papel construida en 1953 a orillas del Golfo de Finlandia. Google aprovechó la infraestructura existente y, sobre todo, la proximidad al mar: el agua de mar filtrada y enfriada circula por el sistema de refrigeración, eliminando la necesidad de torres de enfriamiento y reduciendo drásticamente el consumo energético.

Sostenibilidad: el desafío energético

El consumo energético de los data centers se mide con el indicador PUE (Power Usage Effectiveness), que divide la energía total consumida por la instalación entre la energía que consumen únicamente los equipos de TI. Un PUE de 2.0 significa que por cada vatio destinado a servidores, se consume otro vatio en refrigeración, iluminación y sistemas auxiliares. Los data centers tradicionales tienen PUE entre 2.0 y 2.5. Los más eficientes del mundo, como los de Google, han conseguido valores de 1.1, lo que significa que apenas un 10% de la energía se destina a infraestructuras no informáticas. Cada décima de mejora en el PUE representa millones de euros ahorrados y miles de toneladas de CO₂ evitadas.

La ubicación geográfica es clave para la eficiencia.

Los países nórdicos concentran cada vez más data centers por su clima frío, que reduce las necesidades de refrigeración mecánica, y por su abundancia de energía renovable procedente de hidroeléctricas y eólica. Islandia, Noruega, Suecia y Finlandia compiten por atraer inversiones ofreciendo electricidad barata y limpia. La transición hacia energías renovables es una prioridad para las grandes tecnológicas: empresas como Microsoft, Amazon y Google han comprometido públicamente que sus data centers funcionarán con electricidad 100% renovable en los próximos años (Vía Climatiq).

Algunos proyectos exploran soluciones más radicales, como la energía geotérmica o incluso pequeños reactores nucleares modulares dedicados exclusivamente a alimentar data centers.

El futuro de los data centers apunta hacia la descentralización. El edge computing propone acercar el procesamiento de datos al lugar donde se generan, reduciendo la latencia y la carga sobre los grandes centros.

Esto significa data centers más pequeños, distribuidos en ciudades y conectados entre sí.

La arquitectura deberá adaptarse: edificios más compactos, integrados en entornos urbanos, con requisitos de seguridad y eficiencia iguales a los de las grandes instalaciones pero en formatos más discretos.

Los data centers seguirán siendo invisibles para la mayoría, pero su arquitectura define cómo funciona el mundo digital.